接入 AWS Bedrock 上的模型(DeepSeek)

功能介绍

前置准备

开始部署

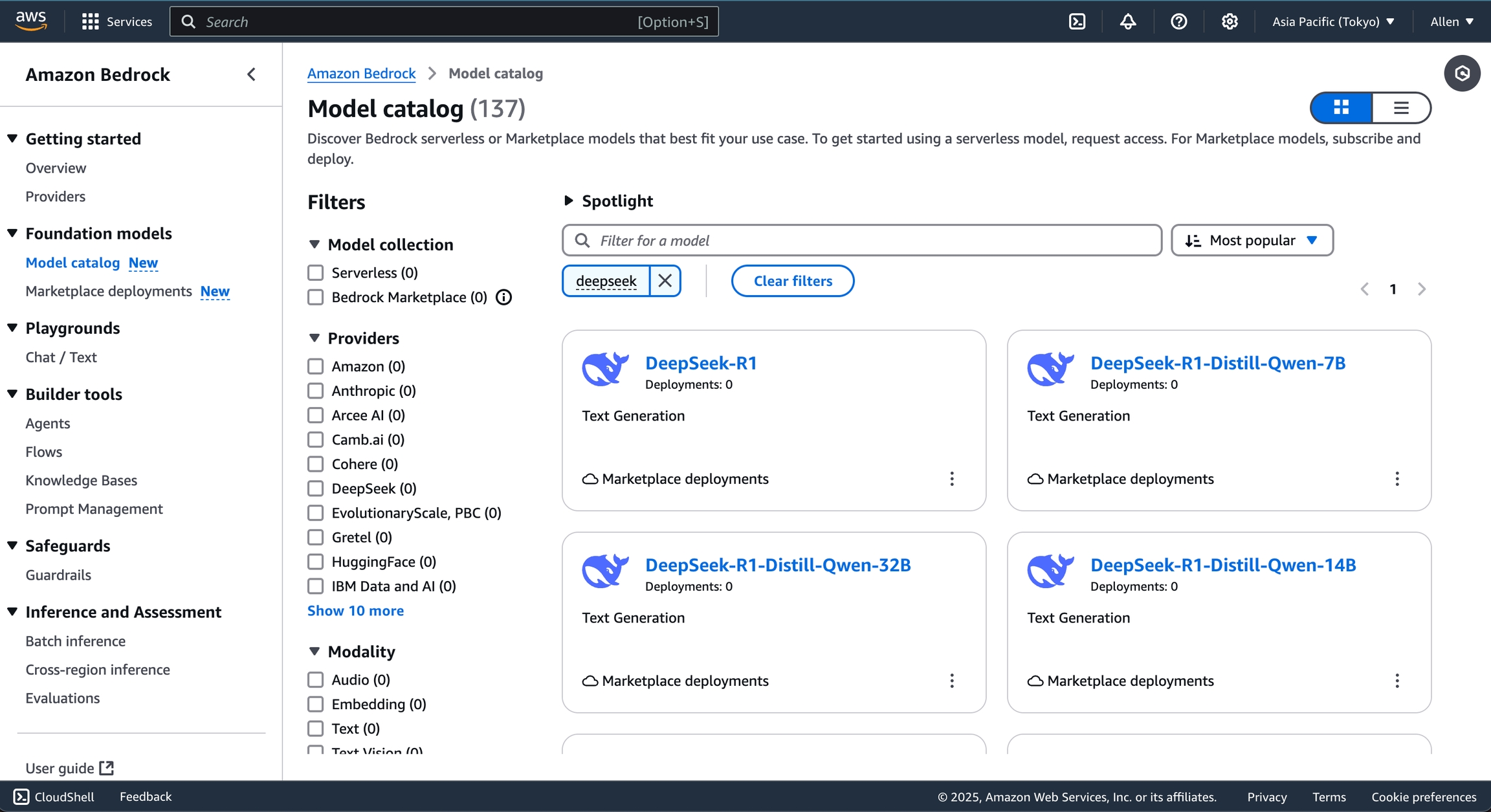

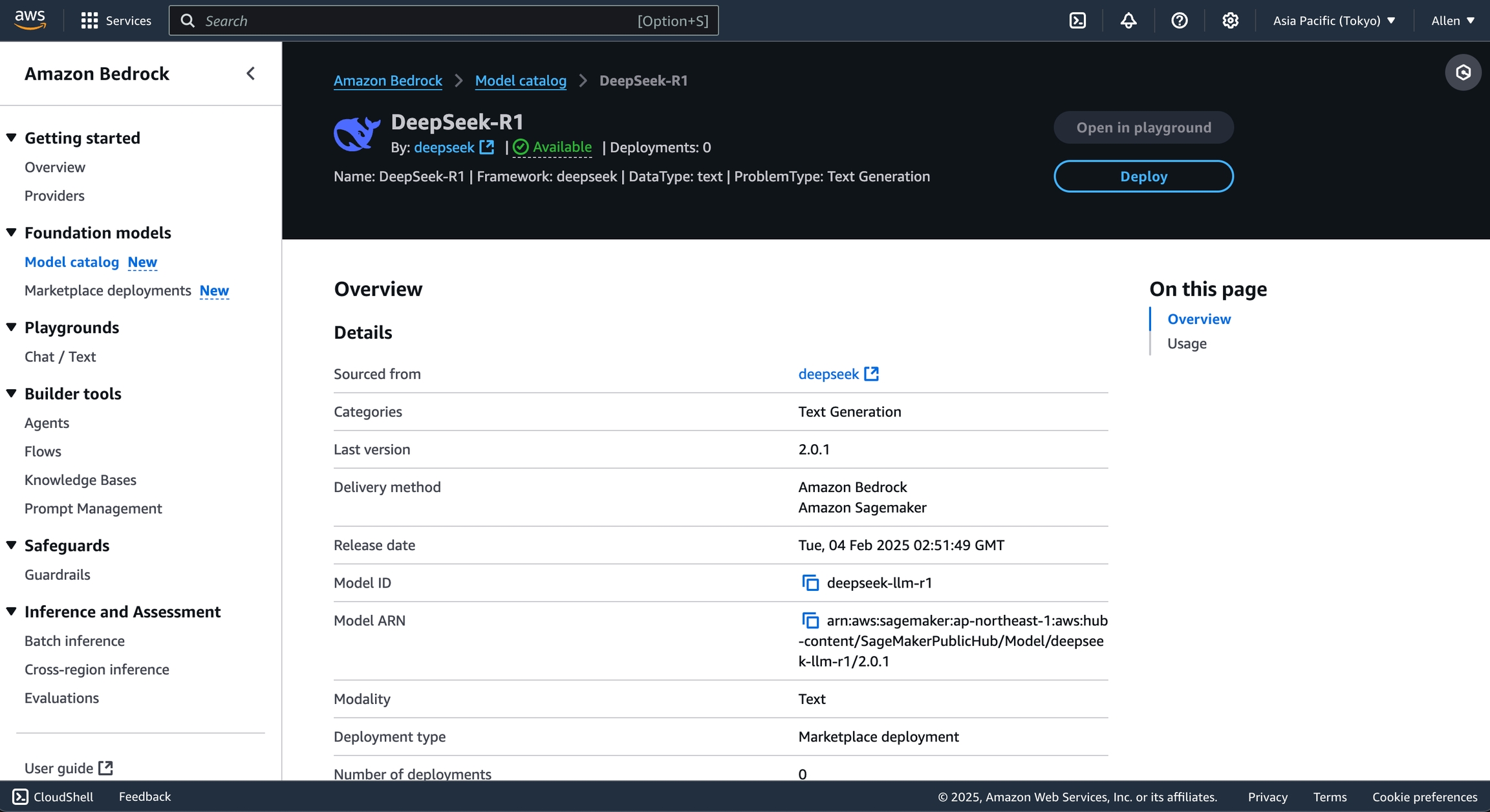

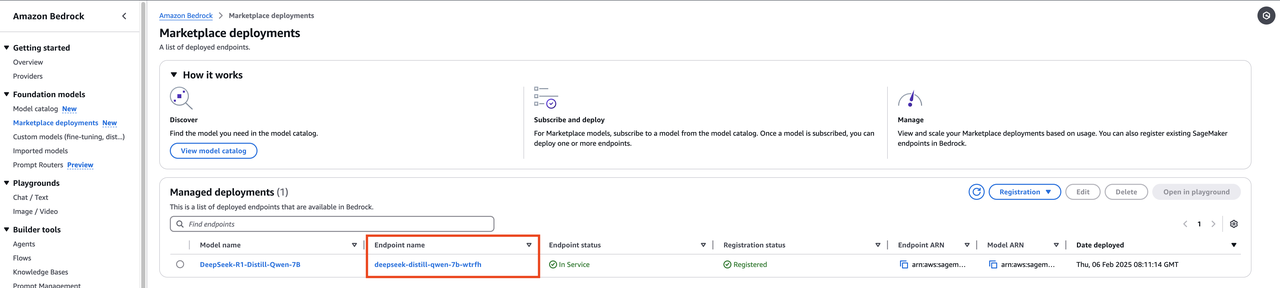

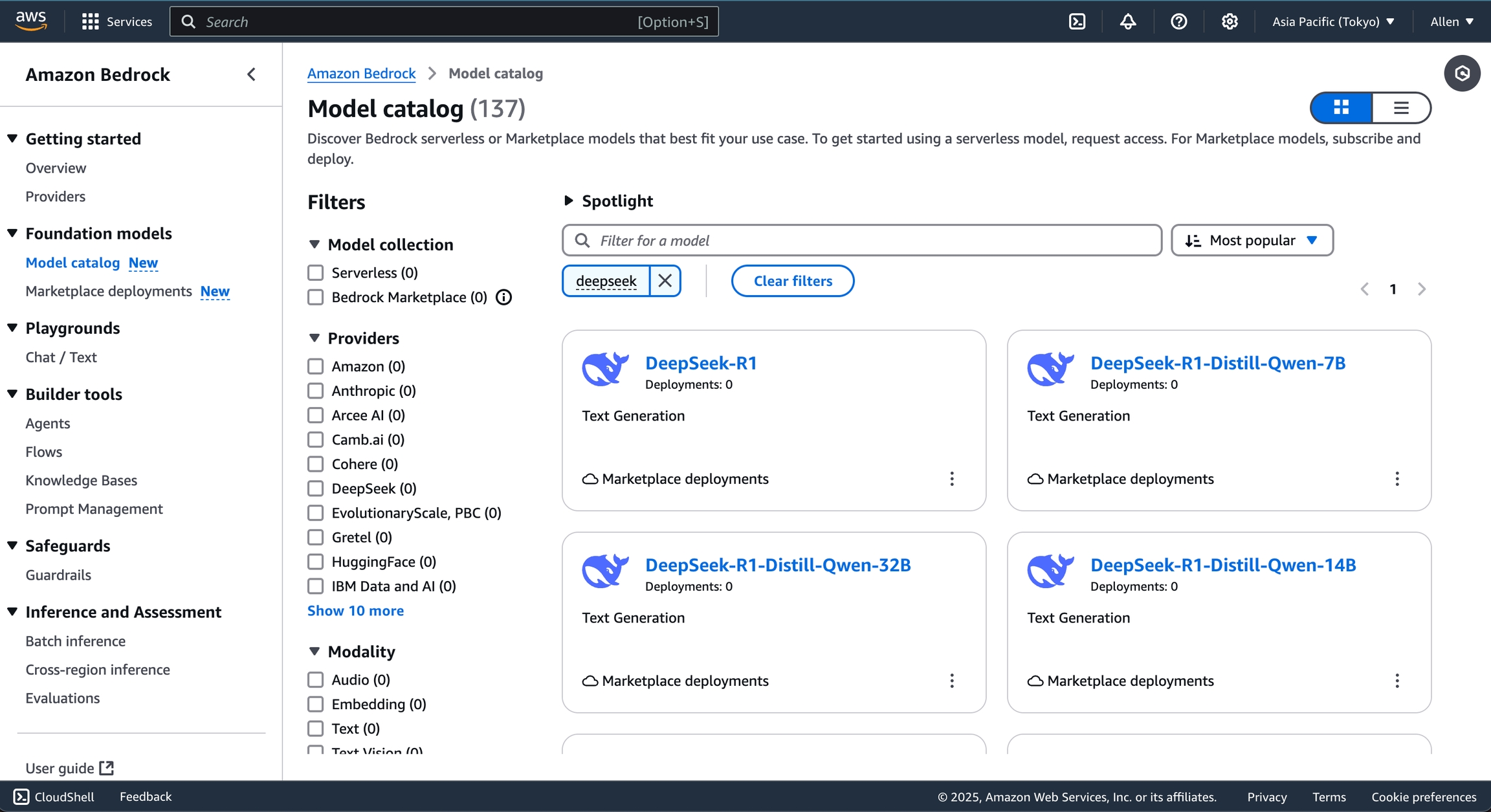

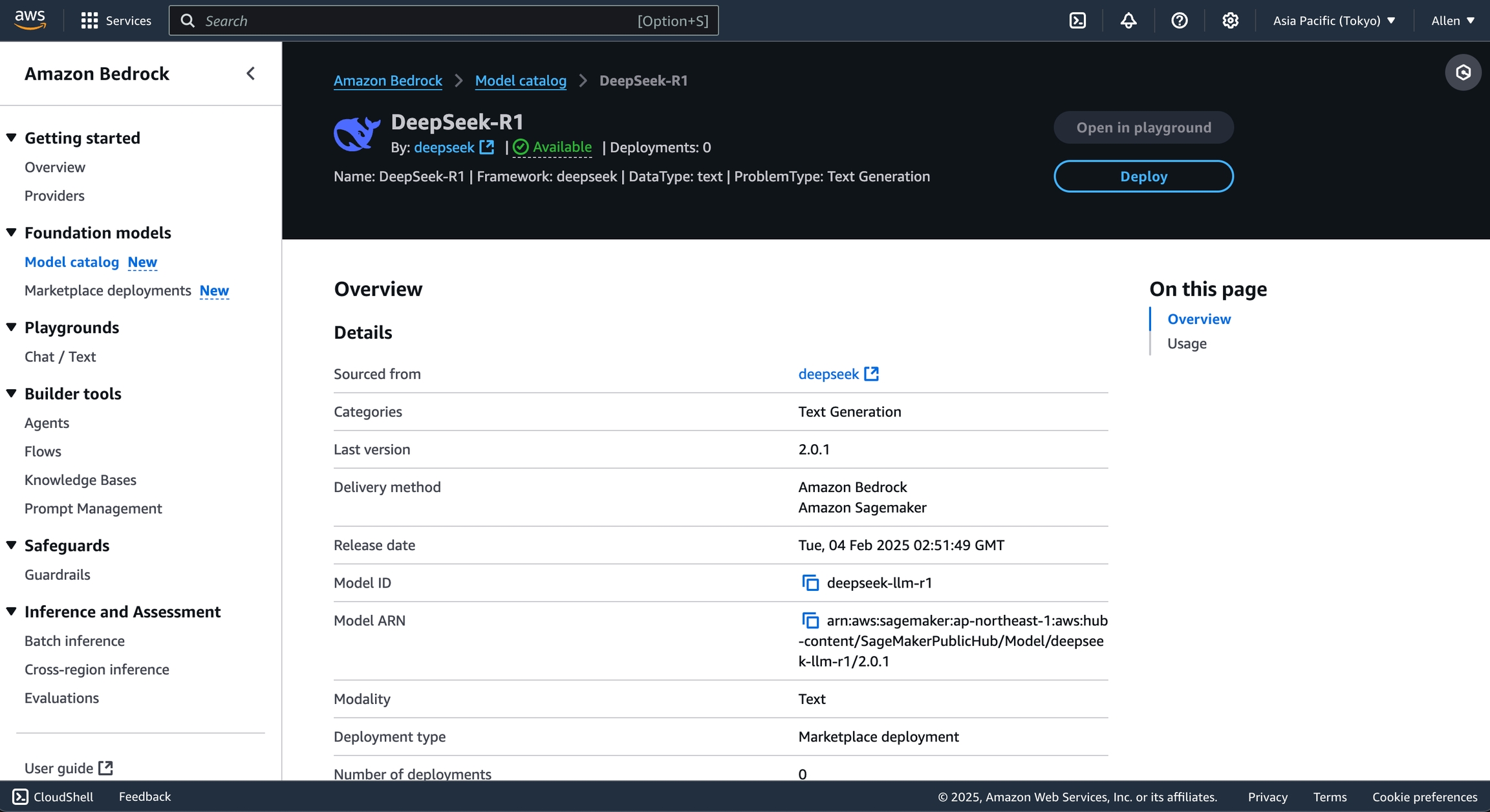

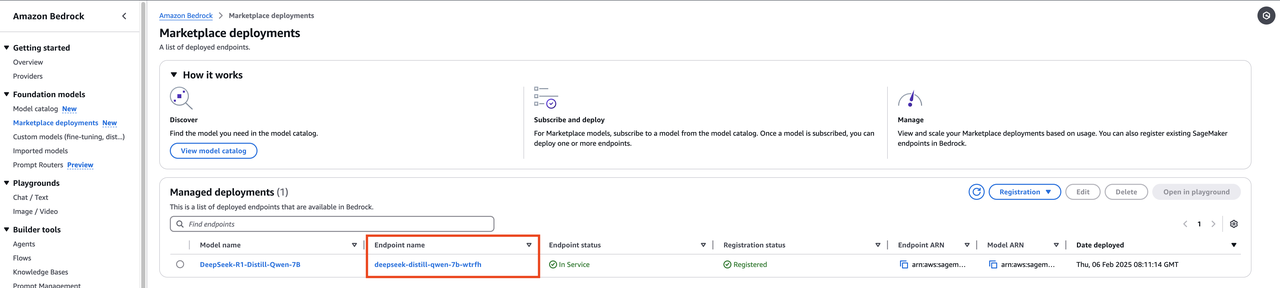

1. 部署 DeepSeek 模型

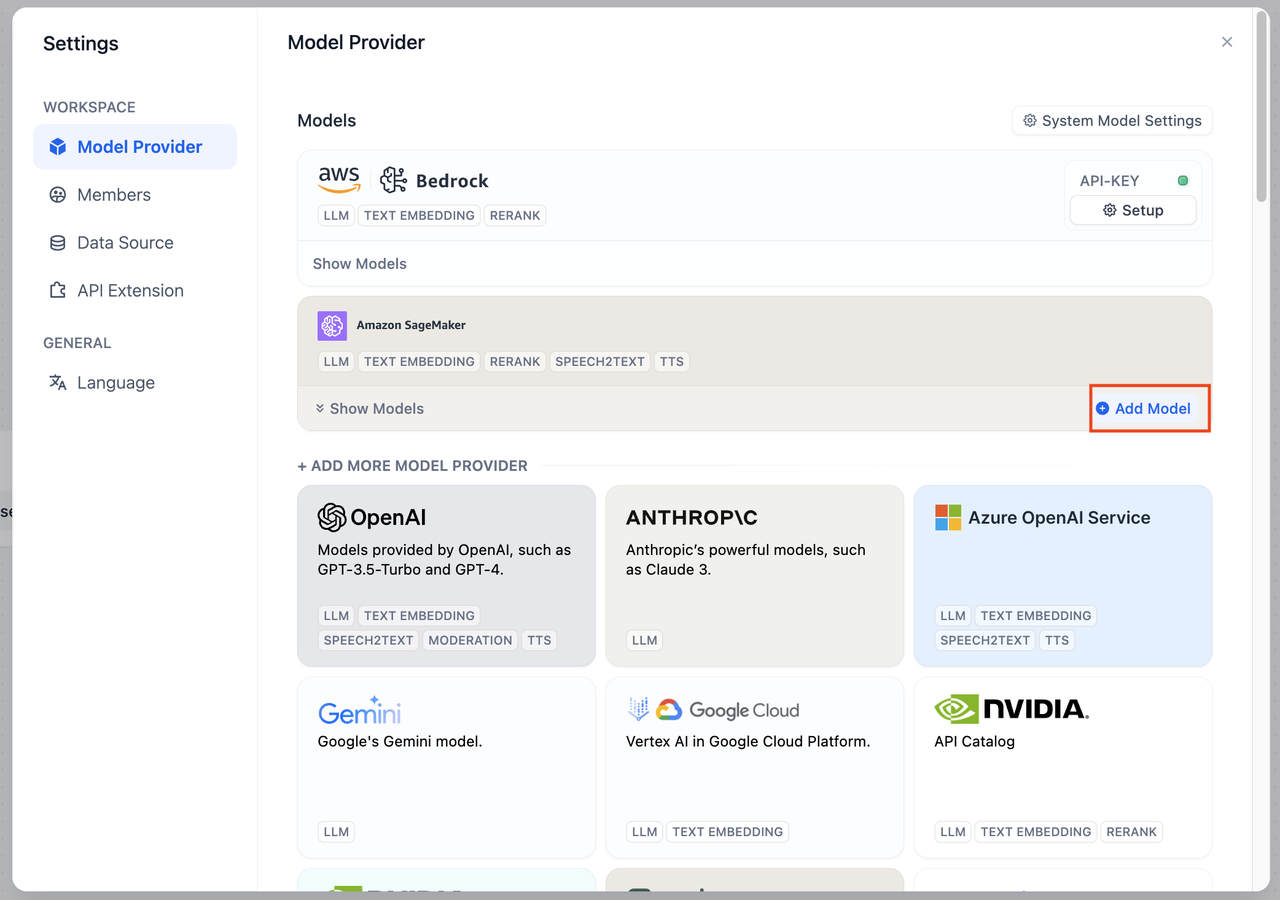

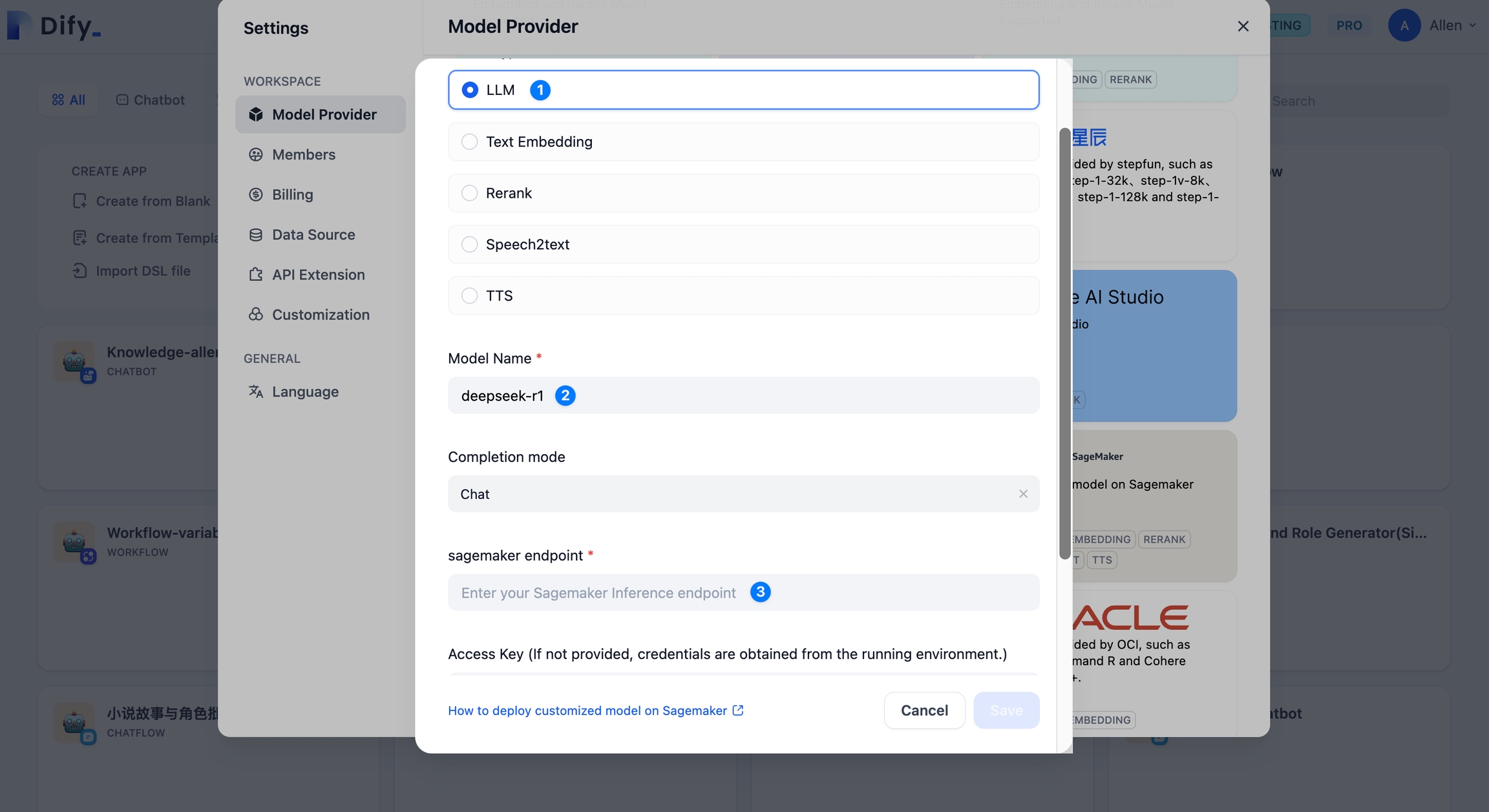

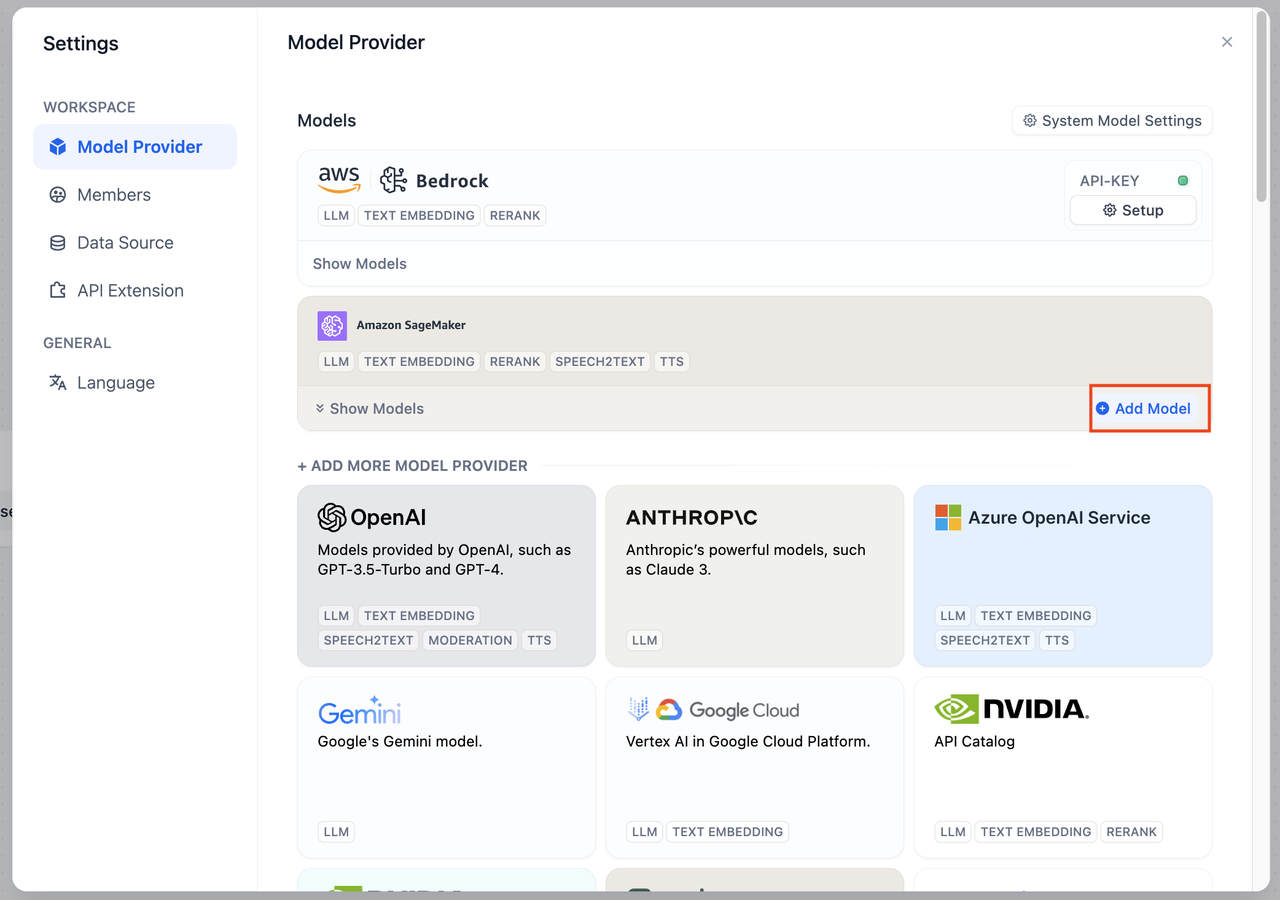

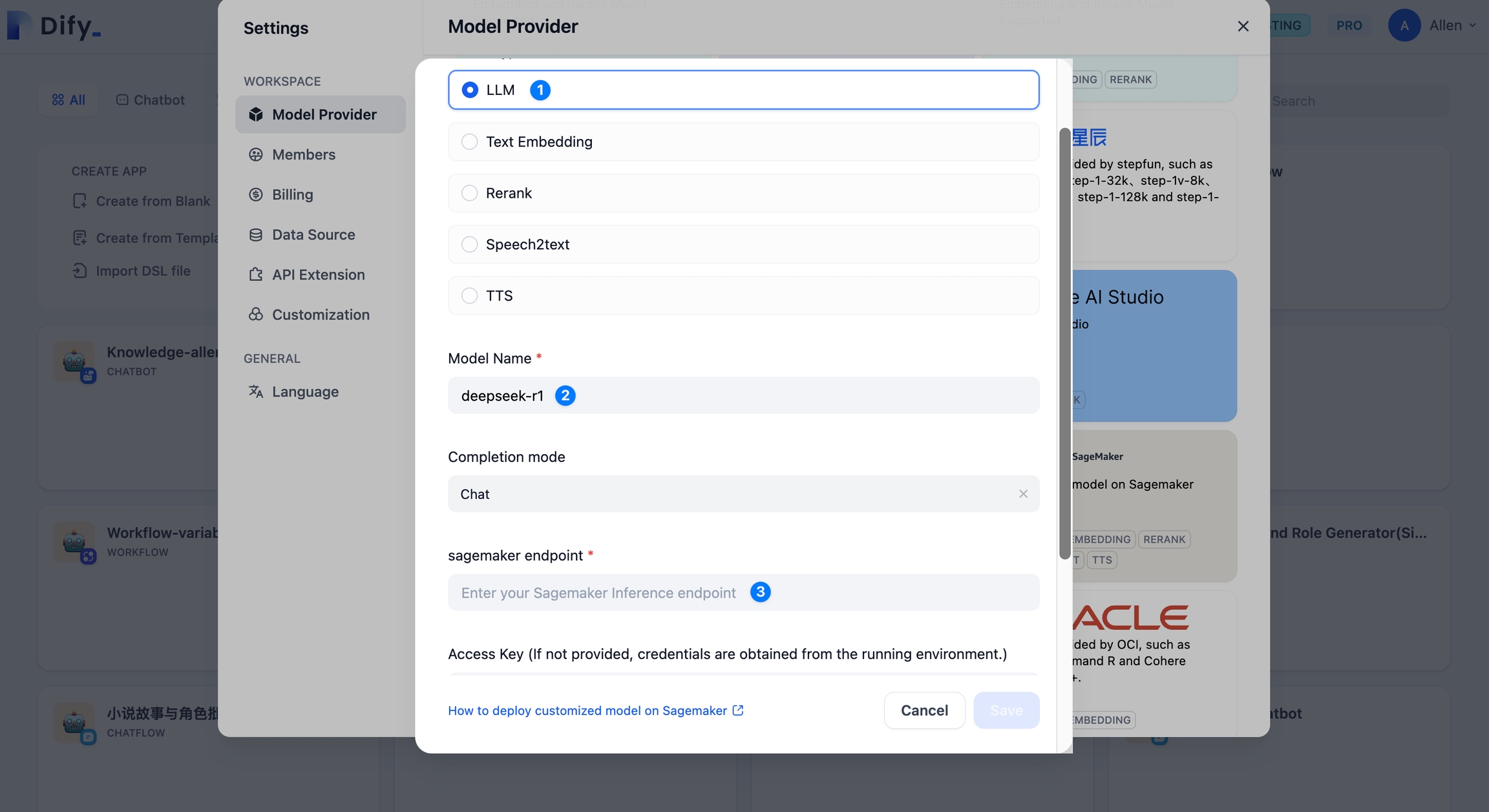

2. 建立 DeepSeek 模型与 Dify 平台的连接

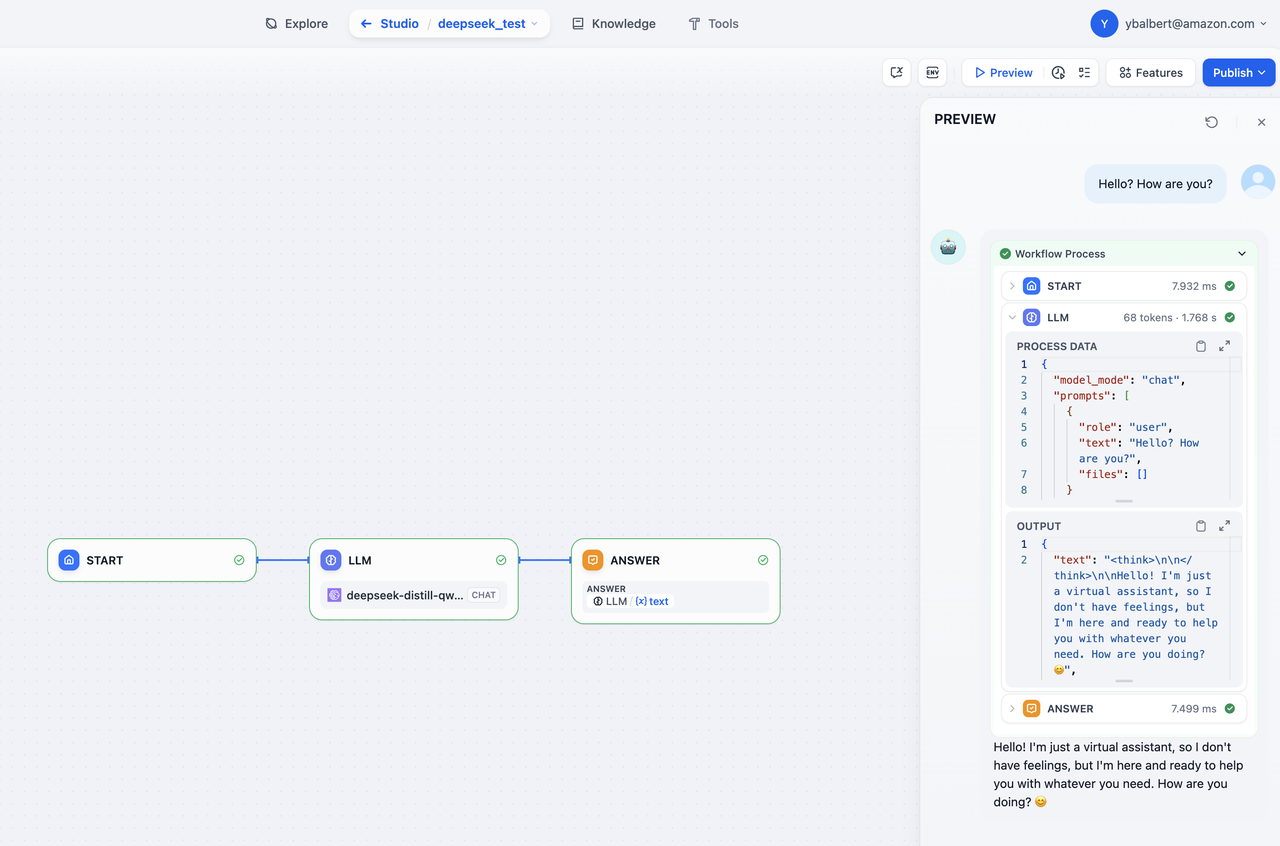

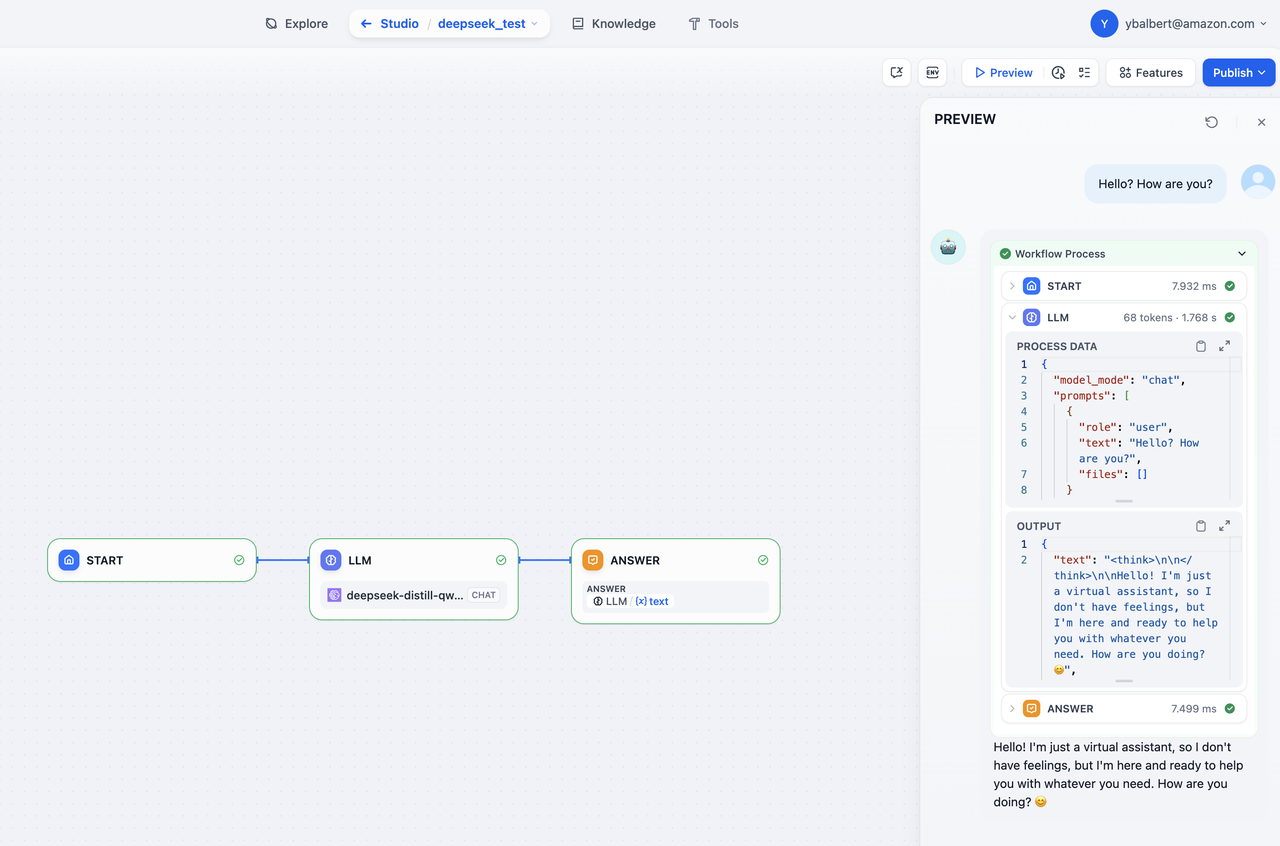

3. 运行模型

常见问题

1. 部署后没有看到 Endpoint 参数?

Last updated

Last updated